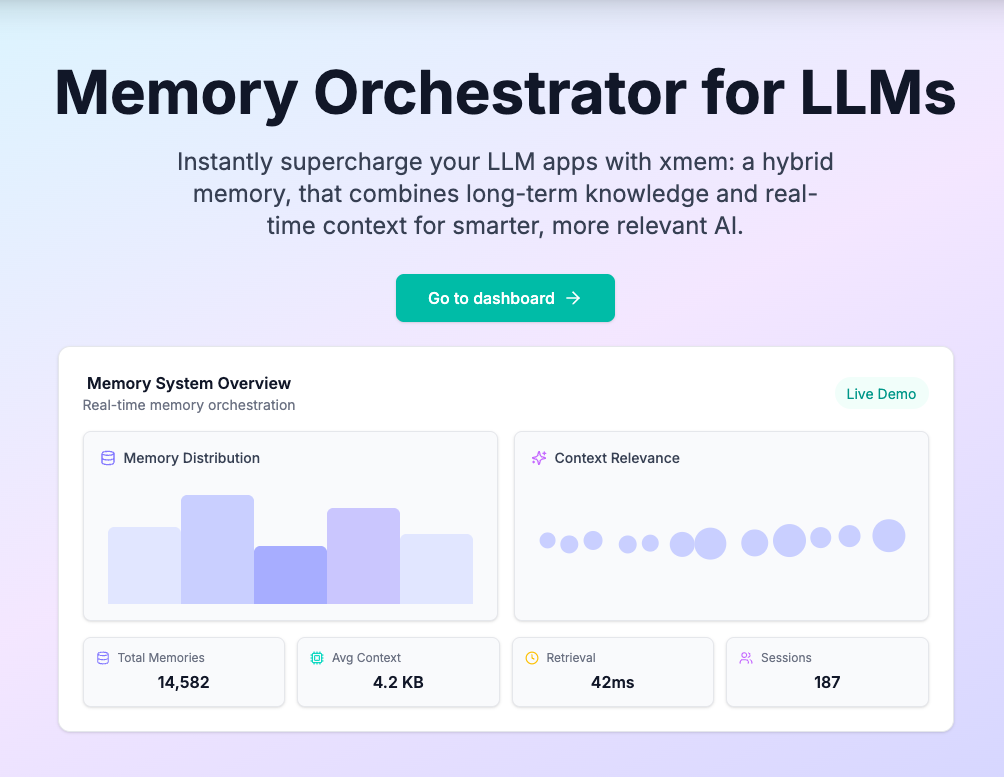

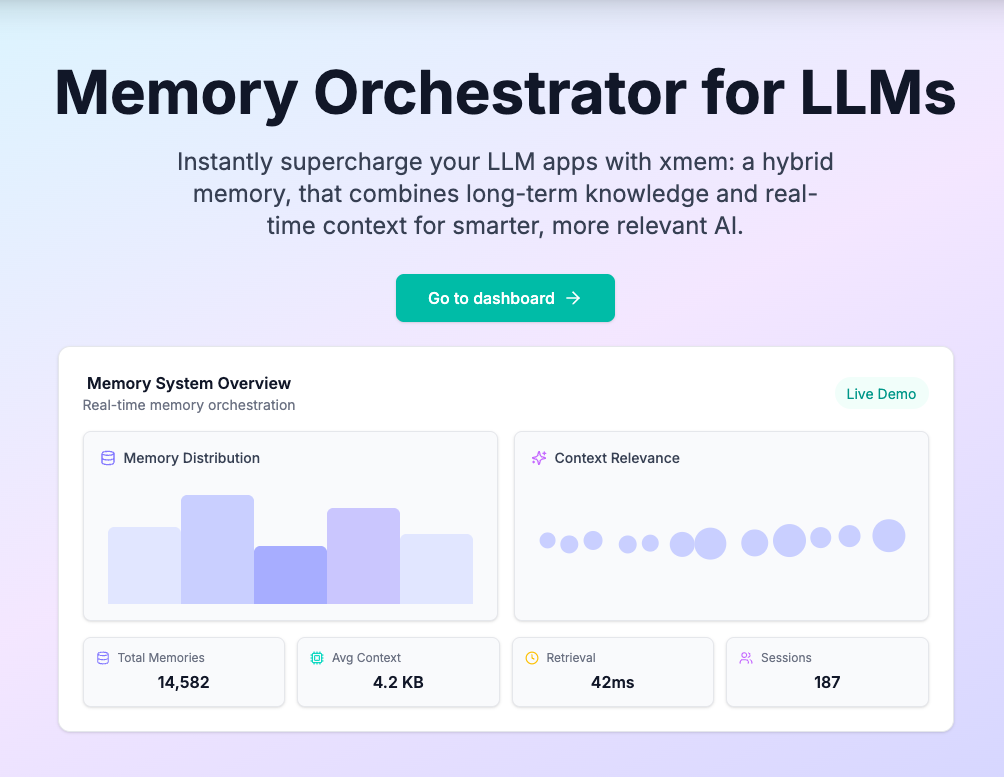

xMem revolutioniert das Speichermanagement für Large Language Models (LLMs). Durch die Kombination von Langzeitspeicher, Sitzungsspeicher und intelligentem Kontextmanagement ermöglicht xMem LLMs, Informationen über längere Zeiträume zu speichern, Gesprächsverläufe zu verstehen und sich dynamisch an den Kontext anzupassen. Optimieren Sie die Leistung Ihrer KI-Anwendungen mit einem effizienteren und intelligenteren Speicher.

← Tool-Liste

Über

Wesentliche Punkte

- Hybrider Speicher (Langzeit, Sitzung, Kontext)

- Erweiterte Informationsspeicherung

- Verständnis des Gesprächsflusses

- Dynamische Kontextanpassung

- Optimierung der LLM-Leistung

- Fortschrittliches KI-Speichermanagement

Anwendungsfälle

- Fortschrittliche Konversations-Chatbots

- Personalisierte KI-Assistenten

- Langzeitanalyse von Textdaten

- Kontextbezogene Empfehlungssysteme

Häufig gestellte Fragen

Was ist hybrider Speicher in xMem?

Hybrider Speicher kombiniert Langzeitspeicher, Sitzungsspeicher und Kontextmanagement, um LLMs ein verbessertes Verständnis und eine verbesserte Informationsspeicherung zu bieten.

Wie verbessert xMem die LLM-Leistung?

Durch effizientes Management von Informationen und Kontext ermöglicht xMem LLMs, genauere und relevantere Antworten zu liefern, selbst bei langen Interaktionen.

Ist xMem für KI-Anfänger geeignet?

xMem ist für KI-Entwickler und -Forscher konzipiert, aber seine Dokumentation und Integration zielen darauf ab, die Akzeptanz für diejenigen zu erleichtern, die mit LLMs arbeiten.

Für wen?

Dieses Tool kann nützlich sein für:

- KI-Entwickler

- NLP-Forscher

- Unternehmen, die LLMs nutzen

- Ersteller von KI-Anwendungen

Tags und Badges

In derselben Kategorie

Nach Kategorie erkunden

Herausgeber

xMem

Über dieses Verzeichnis

Video-IA ist ein kuratiertes Verzeichnis für KI-Tools. Jeder Eintrag wird geprüft und regelmäßig aktualisiert.

Entdecken Sie weitere KI-Tools in unserem Verzeichnis. Kategorien durchsuchen